Выполняя аудит, поисковые маркетологи многократно проверяют сайт с помощью различных сервисов и инструментов, позволяющих обнаружить технические проблемы. Эти проблемы часто приводят к резкому падению органического трафика.

Завершив проверку, маркетологи предлагают клиентам отчет о найденных ошибках и план по их устранению. Теоретически, с этого момента начинается восстановление позиций сайта. Однако если владельцы сайта реализуют план исправления ошибок самостоятельно, они могут столкнуться с дополнительными трудностями. Некорректная имплементация плана не только не приносит желаемого результата, но и усугубляет ситуацию. Примечательно, что собственники сайта могут не замечать своих ошибок, обвиняя интернет-маркетинговое агентство в неэффективности аудита и плана развития ресурса.

Чтобы решить эту проблему, маркетологи должны контролировать действия владельцев сайта. Это можно делать с помощью специальных сервисов и программ, а также ручной проверки ресурса. Как это помогает исправлять ошибки и избегать серьезных неудач? Читайте ниже.

Как повторные проверки помогают быстро найти технические проблемы: 5 примеров

Повторные сканирования и ручные проверки позволяют своевременно находить технические проблемы и решать их. Следующие примеры из практики интернет-маркетингового агентства G-Squared Interactive показывают важность использования принципа «доверяй, но проверяй»:

-

Клоакинг и переоптимизация внутренних ссылок

В американское интернет-маркетинговое агентство G-Squared Interactive обратился собственник большого сайта, насчитывающего несколько миллионов страниц. В ходе аудита эксперты агентства установили, что поисковые проблемы ресурса связаны с избыточным количеством и переоптимизацией внутренних ссылок. Специалисты рекомендовали упростить навигацию и сократить количество линков.

Спустя некоторое время владелец сайта сообщил поисковым маркетологам, что естественная посещаемость сайта осталась низкой, несмотря на выполнение рекомендаций. Посетив сайт, эксперты компании увидели, что навигация действительно стала проще, а число ссылок уменьшилось. Однако поисковые системы не повысили позиции сайта в выдаче после внесения изменений. Поэтому специалисты решили проверить сайт с помощью инструментов для веб-мастеров Google.

.jpg)

В ходе проверки выяснилось, что владелец сайта спрятал сложную навигацию и переоптимизированные ссылки от пользователей, но не удалил их с сайта. Линки остались видимыми для поисковых роботов.

Поисковые системы применяют жесткие санкции по отношению к ресурсам, допускающим клоакинг или отображение разных данных для поисковых роботов и пользователей. В данном примере владельцы сайта избежали санкций, так как эксперты агентства вовремя обнаружили нарушение политики поисковиков. Спрятанные ссылки и навигация были удалены в течение нескольких часов, после чего позиции сайта в выдаче восстановились.

-

Партнерский маркетинг

Собственник информационного ресурса, насчитывающего 1,5 млн страниц, обратился в агентство из-за санкций, полученных после внедрения алгоритма Google Panda. Владелец зарабатывал средства с помощью демонстрации рекламных объявлений и партнерского (аффилированного) маркетинга. Именно открытые для индексации партнерские ссылки стали причиной пенальти Panda.

Выполнив аудит, специалисты агентства предложили объединить партнерские ссылки сайта в две группы. В первую группу предлагалось включить линки, которые не приносят дохода. В второй группе должны были остаться ссылки, которые важны для собственника с финансовой точки зрения. По мнению поисковых маркетологов, все ссылки первой группы следовало удалить. Линки второй группы предлагалось закрыть атрибутом nofollow. Также специалисты агентства рекомендовали дополнительные шаги по повышению качества ресурса.

Через несколько недель поисковые маркетологи повторно проверили сайт. На первый взгляд, владелец ресурса точно воплотил рекомендации специалистов. Он удалил старые партнерские ссылки и закрыл новые атрибутом nofollow. Однако эксперты обнаружили несколько страниц, содержащих много открытых для индексации внешних линков.

В ходе беседы с владельцем ресурса выяснилось, что когда-то он создал и опубликовал собственный каталог партнерских ссылок. Потом собственник благополучно забыл об этих линках. После дополнительного обсуждения владелец ресурса удалил часть ссылок из своего каталога, а остальные закрыл атрибутом nofollow. Этого оказалось достаточно для отмены санкций Panda.

-

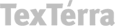

Дублирование метатега Robots

Неправильное использование метатега Robots может привести к катастрофическим последствиям для сайта с точки зрения SEO. Это подтверждается следующим примером из практики упомянутого выше агентства. К поисковым маркетологам обратился собственник интернет-магазина, который не мог добиться индексации всех страниц сайта поисковыми системами. В ходе аудита эксперты быстро выяснили, что краулеры обходят те страницы сайта, в метатеге Robots которых указано значение noindex, nofollow. Специалисты рекомендовали владельцу сайта открыть страницы для индексации.

Однако после выполнения рекомендаций поисковые роботы так и не проиндексировали страницы. Повторная ручная проверка HTML-кода сайта выявила дублирование метатегов Robots. При этом в первом метатеге индексирование было открыто, а во втором закрыто.

Как известно, при дублировании команд поисковые роботы выбирают наиболее ограничивающие правила. Поэтому в рассматриваемом случае страницы сайта остались непроиндексированными. Удалив дублирующиеся метатеги Robots, владелец сайта быстро добился индексации страниц.

-

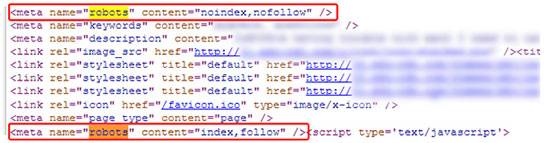

Дублирование заголовков страниц

Переоптимизация или некорректное использование заголовков и метаданных относятся к наиболее распространенным причинам снижения позиций сайтов в выдаче. В этом можно убедиться на примере информационного сайта, владелец которого долгое время не мог понять причины падения поискового трафика. Более того, аудиторы маркетингового агентства также не смогли с первого раза найти ошибки.

В конце концов анализ результатов сканирования сайта с помощью программы Screaming Frog помог определить дублирование заголовков страниц. Из-за технического несовершенства CMS в каждой категории страницы второго уровня имели общий title, совпадающий с заголовком страницы категории первого уровня.

Таким образом, сотни или даже тысячи страниц с одинаковыми заголовками стали причиной низких позиций сайта в выдаче. В данном случае эта ошибка не привела к пенальти. Однако поисковики не считали страницы с неуникальными title релевантными запросам пользователей.

Владелец сайта внес необходимые изменения в CMS, после которых каждая страница второго уровня получила уникальный заголовок. После этого естественный трафик на сайт восстановился.

-

Канонические URL

Использование канонических URL помогает избежать дублирования контента. Однако неверное использование атрибута rel="canonical" иногда приводит к катастрофическим последствиям для сайтов.

Владелец интернет-магазина обратился в маркетинговое агентство с традиционной жалобой на падение трафика. В ходе аудита поисковые маркетологи выявили непоследовательное использование канонических URL. Часть страниц сайта имели соответствующий атрибут, а на других он отсутствовал.

Эксперты рекомендовали владельцу ресурса добавить канонические URL на каждую страницу. Внесение изменений не вызвало затруднений: собственник просто добавил одну строчку в HTML-код страниц. Однако трафик на сайт не восстановился.

Повторная проверка ресурса выявила ошибку: ссылки в теге канонического URL содержали большие и маленькие буквы, тогда как оригинальные ссылки содержали только маленькие буквы.

В результате этой ошибки все страницы указывали в качестве канонического URL, ведущий на несуществующие страницы. Неудивительно, что интернет-магазин практически не получал органического трафика. Владелец сайта быстро решил проблему, исправив ошибку в ссылках.

Доверяй, но проверяй

Доверие — обязательное условие успешного сотрудничества маркетологов и владельцев сайта. Однако если клиенты предпочитают реализовывать планы развития сайтов самостоятельно, специалистам по поисковому продвижению стоит контролировать их действия. Это необходимо хотя бы для того, чтобы избежать обвинений в некачественном проведении аудита и предложении неэффективных шагов по оптимизации сайта.

Маркетологи могут проверять сайты с помощью сервисов и программных средств. Например, они могут воспользоваться инструментами для веб-мастеров Google и «Яндекс», Google Analytics и «Яндекс.Метрикой», программами Netpeak Spider, Screaming Frog и другими средствами. Также специалистам необходимо оценивать внесенные изменения вручную, выборочно проверяя код страниц и результаты выдачи.

Как вы считаете, могут ли владельцы сайтов самостоятельно работать с сайтами по рекомендации маркетологов? Должны ли маркетологи в этом случае контролировать клиентов?

Дмитрий Дементий, перевод материала 5 Examples of How Recrawling Site Changes Can Nip SEO Problems in the Bud by Glenn Gabe.

Читайте также:

*Facebook принадлежат Meta, которая признана экстремистской организацией и запрещена на территории РФ