На международной конференции AI Journey сервис Авито заявил, что присоединяется к Кодексу этики в сфере искусственного интеллекта. Этот кодекс устанавливает общие этические принципы и стандарты поведения, которыми следует руководствоваться компаниям, которые работают с ИИ.

У Авито алгоритмы искусственного интеллекта интегрированы повсеместно: они работают при регистрации и подаче объявления, отвечают за персонализацию ленты и монетизацию, под их контролем система репутации, логистика и техподдержка.

«Присоединение к Кодексу этики ИИ для нас важный и закономерный шаг, который поможет повысить осведомленность и доверие пользователей к высокотехнологичным продуктам Авито, работающим на основе ИИ», — говорит управляющий директор Авито Влад Федулов.

Кодекс этики в сфере ИИ подписан Сбером, Яндексом, ВКонтакте, Росбанком, МТС, Газпромом, Фондом «Сколково», Росатомом, Ростелекомом, Норникелем и рядом других компаний – всего 247 российскими организациями, а также 44-мя федеральными органами исполнительной власти: Минэкономразвития, МИДом, Минпромторгом, Минтрансом, Минэнерго, Росавиацией и прочими.

Для чего нужен Кодекс

Его авторы говорят, что Кодекс нужен для интеграции ИИ в сферы жизни общества. Например, не только в торговлю, но и в образование, в науку, в прочий бизнес. То есть, нужно дать обещание не выходить за некие рамки. Но если вы выйдете, то ничего страшного, пока это не нарушает законы РФ.

Кодекс этики в сфере ИИ принят 26 октября 2021 года. Он разработан Альянсом в сфере ИИ, объединяющим ведущие технологические российские компании. В разработке документа принимали участие Аналитический центр при Правительстве РФ и Минэкономразвития.

Для реализации положений Кодекса будут назначены уполномоченные по этике ИИ и созданы коллегиальные комиссии по этике. Они станут следить за соблюдением «человеко-ориентированного и гуманистического подхода при развитии технологий ИИ», а также за соблюдением «принципов недискриминации, безопасности работы с данными и информационной безопасности, идентификацией ИИ в общении с человеком и уважением автономии воли человека». То есть, речь об ответственности за последствия применения ИИ. Правильная забота.

Но все это регламентируется старыми российскими законами, написанными до распространения ИИ. В них предусмотрены наказания за дискредитацию, утечку данных, есть закон свободы и еще куча законов, статей и пунктов, которые касаются, в том числе, и нейросетей – опосредовано, через людей и организации. За действия искусственного интеллекта отвечает его создатель/куратор/оператор/выгодоприобретатель/контролер – называйте, как хотите.

Кодекс же общими словами объединяет все это, но без ссылок на законы, если не считать этого абзаца с общим перечислением:

«Кодекс учитывает законодательство Российской Федерации, в том числе Конституцию Российской Федерации, иные нормативноправовые акты, документы стратегического планирования, включая Национальную стратегию развития искусственного интеллекта, Стратегию национальной безопасности Российской Федерации, Концепцию регулирования искусственного интеллекта и робототехники, а также ратифицированные Российской Федерацией международные договоры и соглашения, применимые к вопросам обеспечения прав и свобод граждан в контексте использования информационных технологий».

Юридической силы документ не имеет, соблюдение его пунктов – добровольное (главное – законы не нарушать), а что до комиссий, то их пока нет и неизвестно, как они будут работать. Но то, что у них не будет никакой власти, – это однозначно.

Пока существует одна комиссия, членами которой «рассматриваются заявления Акторов ИИ на присоединение к положениям настоящего Кодекса, и ведется реестр Акторов ИИ, присоединившихся к Кодексу».

О чем говорится в Кодексе

Глаголов в Кодексе, в отличие от законов, минимум, да и значение их – общее до туманного состояния. Судите сами:

«Кодекс распространяется на отношения, связанные с этическими аспектами создания (проектирования, конструирования, пилотирования), внедрения и использования технологий ИИ на всех этапах жизненного цикла, которые в настоящее время не урегулированы законодательством Российской Федерации и/или актами технического регулирования».

Распространяется, и…? Например, если кто-то с помощью ИИ захочет обманывать, то им займутся правоохранительные органы, а не комиссия, одним пальцем тыкающая в текст кодекса, а другим – грозящая аферисту.

А вот еще:

«Акторы ИИ должны принимать необходимые меры, направленные на сохранение автономии и свободы воли человека в принятии им решений, права выбора…».

И как теперь быть с сообщениями, что «Программа допустила недопустимую ошибку и будет закрыта», под которыми всегда только одна кнопка «Ок»? Где свобода выбора? Куда жаловаться?

«Акторы ИИ должны знать и соблюдать положения законодательства Российской Федерации во всех сферах…».

Секундочку! Это касается всех людей, находящихся на территории РФ. Или это расчет на то, что Кодекс захотят подписать Google, Apple или подобные компании? Теперь не подпишут.

«Акторы ИИ должны соблюдать законодательство Российской Федерации в области персональных данных и охраняемых законом тайн при использовании СИИ; обеспечивать охрану и защиту персональных данных…».

Та же ремарка – а кто не должен?

«Акторам ИИ рекомендуется осуществлять добросовестное информирование пользователей об их взаимодействии с СИИ… и обеспечивать возможность прекратить такое взаимодействие по желанию пользователя».

Как часто вы натыкались на роботов при звонках в организации и не могли переключиться на оператора-человека? У вас всегда есть выбор закончить «разговор», не решив свой вопрос.

«Акторы ИИ могут внедрять системы добровольной сертификации соответствия разработанных технологий ИИ нормам, установленным законодательством Российской Федерации».

Откуда здесь в одном предложении взялись слова «добровольной» и «установленным законодательством Российской Федерации»?

«В целях своевременного обмена передовым опытом полезного и безопасного применения СИИ, построенного на базовых принципах настоящего Кодекса, повышения прозрачности деятельности разработчиков и поддержания здоровой конкуренции на рынке СИИ, Акторы ИИ могут создавать свод наилучших и/или наихудших практик решения возникающих этических вопросов в жизненном цикле ИИ, отбираемых по критериям, установленным профессиональным сообществом, и обеспечивая публичный доступ к данному своду практик».

Ключевое слово в этом абзаце – «могут». Если после него поставить «не», то смысл не изменится. Акторы могут делать это и без кодекса.

Вывод

Пока Кодекс ничего не дает, кроме инфоповода о присоединении/подписании. Это вход в клуб, ценность членства в котором не объясняется. Возможно, когда-нибудь…

Кодекс создан для того, чтобы он был.

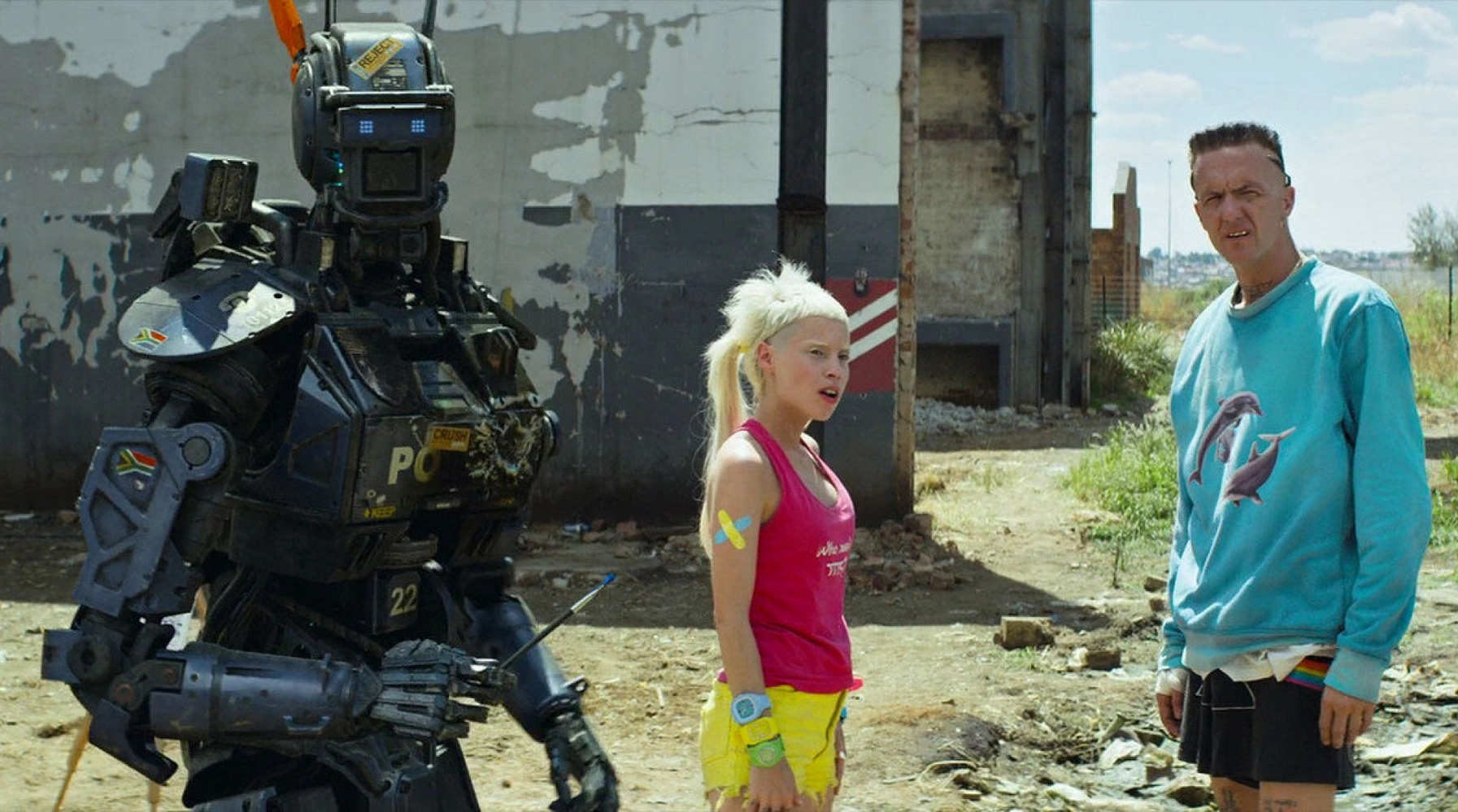

Гораздо больше смысла вы найдете в трех принципах робототехники, сформулированных Айзеком Азимовым в 1986 году (37 лет назад):

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит. Первому или Второму Законам.

Тут даже интересы ИИ учтены (его хозяина)! И обойти эти законы невозможно, несмотря на описанный в фильме 2004 года «Я, робот» бунт Вики – он, объясненный вторым законом, был невозможен из-за первого закона (но сценаристы и режиссер решили посмотреть «а если?»).

Кодекс имел бы больше смысла и пользы, если бы состоял из структурированных ссылок на научную фантастику, в которой подробно описываются проблемы и опасности нейросетей и последствия допускаемых ошибок.

Читайте также:

Нейросеть Kandinsky – тест возможностей [Обновлено]

Лучшая нейросеть-переводчик на русский: тест-драйв TexTerra

Новая песня Битлов уже в сети — слушаем «воскресшего» Леннона