Первую версию Kandinsky Сбер показал в июне 2022 года. За прошедшие месяцы продвинутая (на тот момент) нейросеть стала рядовым алгоритмом генерации изображений. Второй версией Сбер реально удивил, а версией 2.2 – еще больше. В октябре 2023 года стала доступна и генерация видео — в самом конце расскажем, как она работает.

Какой была версия Kandinsky 2.0?

Нейросеть Kandinsky 2.0 была представлена на конференции AI Journey, которая прошла 23-24 ноября. Главным нововведением, на котором Сбер акцентировал внимание, была функция генерации изображений по описаниям на 101 языке. Российская компания также заявила, что нейросеть способна создавать изображения одинаково легко и быстро вне зависимости от того, на каком языке задан запрос.

Это впечатляющая функция, учитывая, что большинство современных нейросетей заточены под английский язык. Среди немногих исключений китайская ERNIE-ViLG и адаптированные под различные языки аналоги Midjourney и Stable Duffusion.

Попробовать нейросеть от Сбера в работе можно на сайте проекта Fusion Brain.

Картины нейросети Kandinsky 2.0

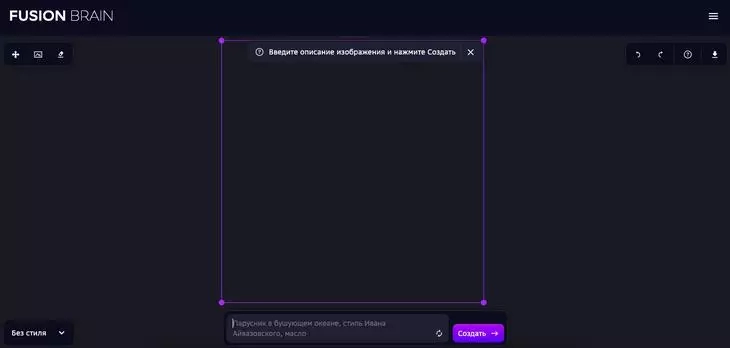

Заходим в нейросеть Kandinsky 2.0 и что мы видим? Удобный и красивый интерфейс, который не идет ни в какое сравнение с дискорд-ботом Midjourney или интерфейсом Hugging Face – сервисом, на котором размещают свои алгоритмы разработчики других нейросетей.

Кнопки в верхнем левом углу позволяют передвигать изображение, загружать фото с компьютера и стирать части изображения при помощи ластика (его размер регулируется ползунком).

В нижнем левом углу можно выбрать стиль, в котором будет создаваться изображение, а в верхнем правом есть инструменты для отмены действий и скачивания результата работы нейросети.

Мы тестировали версию 2.0 на 5 запросах:

- огромный кот в океане играет кораблями. Стиль «Айвазовский»

- огромный кот в океане играет кораблями. Стиль 3D-рендер

- космос в дырке унитаза. Без стиля

- лапы кота на снегу (на корейском)

- лапы кота на снегу (на испанском)

Первыми двумя запросами проверяли стилизацию, третий использовали для проверки «мышления» нейросети, а последние два для проверки того, так ли хорошо нейросеть понимает иностранные языки, как это было заявлено. Что нам выдала версия 2.0 по этим запросам — смотрите в галерее ниже:

Все это смотрится на уровне первой версии Midjourney или Stable Diffusion. В целом версия 2.0 понимала другие языки и даже некоторые образы, но стили и понимание расположения объектов ей давались плохо.

В апреле 2023 года Сбер выкатил улучшенную версию своей нейросети. Мы протестировали Kandinsky 2.1 — и это просто прорыв.

Картины нейросети Kandinsky 2.1

Сначала мы решили протестировать те же 5 запросов, что давали версии 2.0 ранее. Что выдала в ответ версия 2.1 — смотрите в галерее ниже:

Впечатляет! Kandinsky 2.1 стал намного лучше понимать запросы и соответствовать стилям художников. Правда, похоже, немного растерял понимание иностранных языков — на запрос «лапы кота на снегу» на корейском языке алгоритм сгенерировал какой-то город в ОАЭ.

Мы вдохновились и попробовали более сложный запрос, чтобы сравнить его с генерацией Midjourney: красочный пейзаж с оленем в горах, в стиле граненых форм, реалистичные иллюстрации птиц, яркие цвета, темно-голубой и янтарный, сцены на открытом воздухе, плоская перспектива, детализированные узоры, яркие цветовые градиенты.

Ниже — сравнение результатов работы Kandinsky 2.1 и Midjourney:

В чем-то нейросеть от Сбера даже превзошла Midjourney — например, она создала это изображение меньше чем за 20 секунд (Midjourney в среднем требуется на меньше 40 секунд в режиме fast). Да и детали у Kandinsky прорисованы лучше, хотя в целом композиция у Midjourney получилась органичнее. Правда, нейросеть от «Сбера» поместила птиц на невидимые ветки, а некоторым пририсовала рога.

Шедевры Kandinsky 2.2

12 июля Сбер снова обновил нейросеть Kandinsky. Она стала еще понятливее — запросы исполняются неукоснительно и довольно точно. Также разработчики добавили новые стили — теперь можно и в киберпанке генерировать, и в реалистичном фотографическом стиле.

Но самое главное — теперь на этапе перед генерацией можно выбрать размер изображения, а точнее — соотношение сторон. Можно сделать 16:9, и у вас будет горизонтальная картинка для сайта, а можно поставить 9:16 и получить вертикальное изображение для поста в соцсети. В общем, смотрите, любуйтесь и пробуйте сами:

Одна из самых интересных функций обновленного «Кандинского» — подобие Zoom Out от MidJourney: можно наложить на сгенерированное изображение рамку, ввести запрос и нейросеть дорисует картинку в нужной части. Получается пока не идеально, но уже очень-очень неплохо. Вот, например, что мне удалось сгенерировать в 4 подхода:

Видео в Kandinsky

Функцию генерации видео в Kandinsky выкатили 12 октября 2023 года. На момент написания заметки доступ к ней есть лишь у активных пользователей и тех счастливчиков, чью заявку на тестирование одобрили в первых рядах. К слову, вы тоже можете подать заявку на подключение в этом боте. В том же боте будет потом происходить и генерация видео. Если получить доступ сразу не получилось, не расстраивайтесь — к концу года фича будет доступна для всех бесплатно.

Мы получили к ней доступ в первых рядах и делимся впечатлениями. Чтобы сгенерировать 4-секундное видео в Kandinsky, нужно ввести текстовый промт. После этого бот предложит вам выбрать направление движения камеры в кадре — можно перемещать ее вправо, влево, вверх и вниз, отдалять, приближать и по-разному поворачивать. Следующий шаг — выбор формата ролика: горизонтальный, вертикальный или квадратный.

В боте можно сгенерировать как одну сцену, так и совместить до трех коротких сцен. Для этого достаточно после выбора паттерна движения камеры ввести текстовый промт. Результат бот пришлет в формате GIF прямо в диалог. Мы задали три запроса:

Черный кот прыгает на комод, реализм, светлые тона, фотография

Ваза разбивается и падает на пол, реализм, фотография

Женщина дома закрывает рот руками от испуга, фотография, реализм

Вот какое видео нам выдала нейросеть:

Kandinsky 3.0

22 ноября Сбербанк представил новую версию. Ее особенностью стало хорошее знакомство с русской культурой и повышение реалистичности фотографий. Конечно же, мы все это протестировали. Но начали с той пятерки запросов, на которой проверяли версию 2.0.

Вот результаты.

Версия 3.0 не поняла запрос на корейском языке, но итоговый результат, хоть и далек от запроса, но весьма красочен и атмосферен.

А теперь взглянем на обещанную русскую культуру.

Баба-яга выглядывает из своей избушки. заснеженный лес

Леший сидит на пеньке, сосновый бор

Кикимора вылезает из болота

Вывод на данный момент: из сказочных персонажей нейросеть познакомили с Бабой-Ягой, но на этом все.

Теперь посмотрим на стили.

Фарфоровый слон, гжель

Айфон, хохлома

На мой взгляд тут нейросеть промахнулась очень сильно. Миджорни, например, на этот запрос выдает результат намного ближе, хотя бы по цветовой гамме.

Но сделаем еще одну попытку

Деревянный сундук с городецкой росписью

Подводя итог: задумка с русской культурой хорошая, но до оптимальной реализации все-таки еще далеко.

И, проведем еще один тест, на реализм.

фотография девушки, длинные светлые волосы, зеленые глаза

Неплохо, хотя легкая «перефотошопленность», то есть искусственность, присутствует.

Фото подростка, играющего в снежки

А вот это уже лучше.

Фото студента, сидящего на лекции

Внезапно вылезла проблема не только с руками, но и с тетрадкой, лежащей на парте.

Но в целом нейросеть явно подняла уровень, а возможность генерировать без ограничений дает простор для творчества.

Видео

Еще одно новшество появилось в видеоредакторе. Можно сгенерировать как анимацию, так и видео.

Для анимации доступно разрешение 640 х 640, для видео – 512 х 512. Кроме этого, оба формата дают возможность создавать не только квадратные кадры, но и использовать соотношение сторон 9:16 и 16:9.

При этом максимальная длительность анимации – 16 секунд. Это 4 сцены по 4 секунды.

У видео длительность 8 секунд и используется только одно описание.

Пример видео по запросу:

Черный кот прыгает на комод, реализм, светлые тона

Пока оно оставляет желать лучшего, но с учетом скорости развития нейросетей можно ждать, что уже через год качество будет выше.

Читайте также:

Выставка с картинами от нейросети DALL-E: как вам такое?

Есть ли в фотобанках работы нейросетей? Разбираемся

Нейросеть от DeviantArt возмутила художников. Она крадет их работы

![Нейросеть Kandinsky – тест возможностей [Обновлено]](/upload/iblock/6f2/tyhsi46z0nto1ihc31siymzy3w95qq50/soc_seti.webp)