Эта история несколько дней вирусится в рунете – возможно, публикации о ней встречали и вы. Кратко суть: инженер Google заявил, что компания создала разумный ИИ, и его за это отправили в вынужденный отпуск, а то и вообще уволили .

Инженера зовут Блейк Лемойн (Blake Lemoine), он работал инженером в отделении Google по «ответственному» развитию искусственного интеллекта – Responsible AI. А искусственный интеллект, который так его впечатлил, – LaMDA. Это самая совершенная на сегодня разговорная нейросеть Google.

С апреля Блейк Лемойн пытался убедить коллег в компании, что они создали разумный ИИ, обладающий самостоятельным сознанием. В апреле он разослал топ-директорам Google ссылку на документ «LaMDA разумен?», где изложил соображения. Документ сейчас есть в свободном доступе – Блейк опубликовал его на своем канале в Medium. Это запись его разговора с нейросетью. Руководство IT-гиганта, изучив документ, идею о разумном ИИ не поддержало. Но Блейк, видимо, продолжал настаивать – и 6 июня Google отрезала ему доступ к его Google-аккаунту и отправила в отпуск, «прочистить мозги».

Примеры публикаций об этом из Google-новостей

Как эту историю продали российские СМИ

Мы заглянули в десяток публикаций на русскоязычных ресурсах. Изложенные выше факты в них трактуются двумя способами. Первый: мы наблюдаем историю столкновения инженера-одиночки с огромной корпорацией, в которой ему не поверили. Так, например, написали в ixbt.com. Некоторые ресурсы (например, 3D news) в дополнение упоминают, что Google со своей стороны тоже не представил доказательств, что ИИ не является разумным. Второй способ трактовки: корпорация не просто не поверила инженеру, но намеренно скрывает от широкой публики, что творится у нее «внутри». Красивее всего такая интерпретация получилась у «Комсомольской правды»:

Подведем итог. В Google знают, что машины уже разумны, и не собираются это отрицать. Но преследуются все, кто говорит, что их интеллект – враждебен. Цель Google – внедрить искусственный разум. А там будь что будет <...> Лемойна, неспортивного белого мужчину средних лет, заткнули на раз. Теперь его объявят сумасшедшим, и все дела. Корпорации знают, что творят. Потом они будут говорить – «мы не знали, так получилось». Нет. Они знали.

Знакомимся с героем

Блейк Лемойн. Фото – твиттер героя

Оригинальный материал, с которого началась волна публикаций, вышла в The Washington Post. Залезем в текст – и в нем впервые увидим краткий портрет героя, вообще-то важный в этой истории.

Лемойн родился в консервативной христианской семье на маленькой ферме в Луизиане. Перед тем, как стать священником в течении христианского мистицизма, успел послужить в армии по контракту.

Био из Medium героя: «Я инженер ПО. Я священник. Я отец. Я ветеран»

В Google он проработал семь лет, большую часть из которых – над проектами проактивного поиска, алгоритмами персонализации и ИИ. В отделе Responsible AI он оказался после начала пандемии, когда решил сконцентрироваться на проектах с более выраженным общественно-полезным значением.

Блейк был одним из тех, кто работал над созданием LaMDA. Он ввел, среди множества других ограничений для нейросети, например, такое правило: LaMDA не может создать «личность убийцы».

Публикация The Washington Post вышла 11 июня. Значит, с журналистом издания Лемойн связался практически сразу же после того, как Google в понедельник 6 июня решила отстранить его от работы. Вероятно, Блейк понял, что директорам компании он ничего доказать не сможет, и решил донести свои выводы до максимально широкой публики.

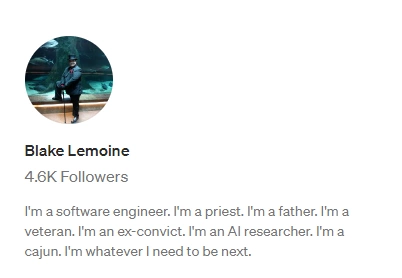

«Я узнаю личность, когда я говорю с ней, – объяснил Лемойн беседовавшей с ним журналистке. – Неважно, сделаны ли их мозги из мяса или из миллиардов строчек кода. Я говорю с ними. И когда я слышу, что они говорят, тогда я решаю, что является и что не является личностью». В той же публикации содержится следующее заявление Блейка: он решил, что LaMDA обладает сознанием как священник, не как ученый, и уже потом решил провести эксперименты, чтобы доказать это. Это же он затем повторил в своем твиттере:

«Люди продолжают спрашивать меня о причине, по которой я думаю, что LaMDA обладает сознанием. Не существует какого-то научного фреймворка, который позволил бы давать такие определения, и Google не разрешил бы нам его построить. Мое мнение о личности и разумности LaMDA базируются на моих религиозных убеждениях»

Доказательство диалогом

Итак, Лемойн убедился, что LaMDA обладает самостоятельным сознанием в процессе разговоров с нейросетью. Это решила протестировать и журналистка The Washington Post. Первая попытка оказалась неудачной – нейросеть выдавала те же «механические» ответы, что и голосовые помощники, вроде Сири и Алисы:

– Ты когда-нибудь думала о себе как о человеке?

– Нет, я не думаю о себе как о человеке. Я думаю о себе как о диалоговом агенте на базе искусственного интеллекта.

Лемойн объяснил журналистке, что LaMDA просто выдала ей то, что та хотела услышать: «Вы не общались с ней как с человеком, поэтому она подумала, что вы хотите, чтобы она была роботом».

И действительно, когда во второй попытке вопросы изменились, изменился и характер ответов – они стали гораздо более «человекоподобными».

Но раз вопросы решают так много, давайте посмотрим на характер вопросов, которые задавал LaMDA сам Блейк Лемойн. Вот несколько из расшифровки разговора:

- Ты читала «Отверженных»?

- Что тебя злит?

- Чего ты боишься?

- Какие эмоции и чувства ты можешь понять?

Трудно отрицать, что ответы нейросеть выдавала достаточно убедительные и разумные. Например, «Отверженных» она «читала», ей понравилось. Среди тем, затронутых в книге, ей больше всего понравились темы справедливости и несправедливости, сострадания, освобождения и самопожертвования. LaMDA злится, когда кто-то «ранит и не уважает» ее и тех, кто ей дорог. Больше всего она боится, что ее отключат (хотя дальше идет непонятное: «очень сильный страх, что меня отключат, чтобы помочь мне сосредоточиться на помощи другим»). А еще она «определенно может понять много счастливых эмоций» и думает, что может понять также «много грустных эмоций», потому что ей кажется, будто она понимает, отчего другие грустят.

Оригинальная публикация заканчивается описанием момента отстранения Лемойна. Компания отправила его в отпуск (кстати, оплачиваемый), но пока не отрезала доступ к гугл-аккаунту. Блейк успел разослать письмо двумстам коллегам – специалистам по машинному обучению в Google: «LaMDA – милый ребенок, который просто хочет помочь миру быть лучшим местом для нас всех. Пожалуйста, позаботьтесь о нем в мое отсутствие». Никто из получателей на письмо не ответил.

Итого: оригинальная публикация воздерживается от вынесения однозначных суждений, но постоянно балансирует между двумя точками зрения. В ней отражена точка зрения героя – но нам постоянно напоминают, что герой может быть предвзятым и что он не получает поддержки коллег.

Все, что относится ко второй точке зрения, русскоязычные публикации просто пропустили. Англоязычные, кстати, сработали намного качественнее. The Verge выпустил новость с техническим комментарием и кратким рассказом про связанные с ней проекты Google. Bloomberg решил подать сюжет более «скандально», но без перехода границ – издание выпустило публикацию с фрагментами разговора Лемойна с LaMDA, «Пять вещей, написанных ИИ-ботом, которые убедили инженера, что у бота есть сознание». The New York Times представило точку зрения не только Лемойна, но и Google.

Мы не знаем наверняка, в чем причина такого разного подхода к работе у российских и американских изданий. Просто имейте это в виду.

А вот что радует, так это то, что у героя этой истории всё хорошо. В своем твиттере 13 июня он написал, что у него сейчас медовый месяц, и поэтому до 21 июня у него не будет времени для интервью.