«Что если у нас получится?»

Стюарт Рассел

I. Апокалипсис завтра

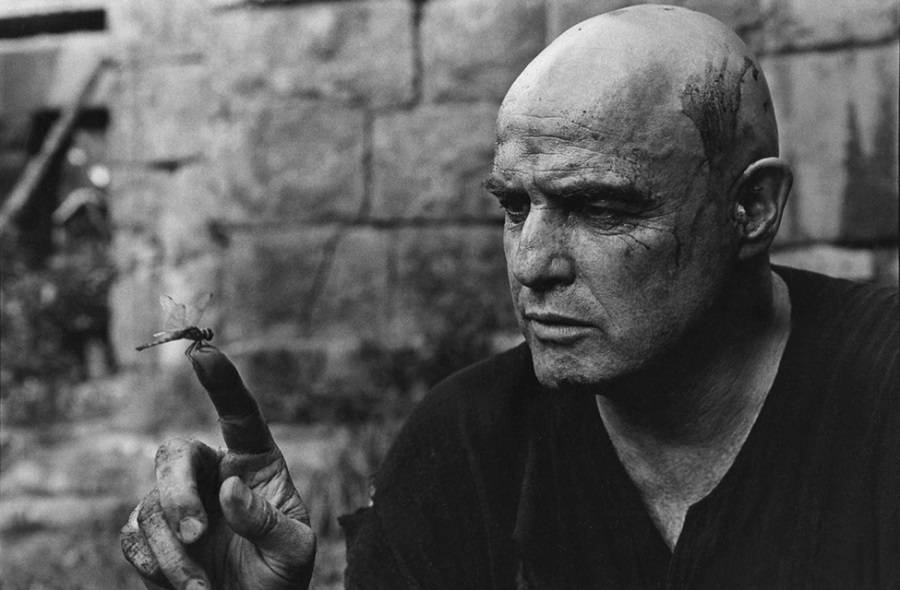

В своей книге Сверхинтеллект: Возможности, Риски, Стратегии Ник Бостром рисует пессимистичный сценарий развития искусственного интеллекта: как только появится ИИ равный человеческому интеллекту, сверхинтеллект будет одним из первых его изобретений. А дальше «скрипач не нужен», сверхразумные информационные системы могут самообучаться и воспроизводить еще более сложные системы, контролировать производство и распространение конкурирующих ИИ, предаваться агрессивной мальтузианской гонке с другими разумными агентами на лоне Искусственной Природы.

Экзистенциальные риски от соседства сверхразума и человека вырастают в разы. Ник Бостром предупреждает, что сверхинтеллект способен обучаться быстрее и эффективнее своих создателей и, если не привить ему человеческие ценности, то все может закончиться плачевно, т.к. сверхинтеллект сможет не только регулировать дальнейшее производство умных машин, он будет успешно препятствовать попыткам людей скорректировать его работу или помешать ему.

Автобиографическое отступление: Ник Бостром в среде ученых и философов известен как любитель ужастиков — он возглавляет институт, который занимается поиском и публикацией экзистенциальных рисков, работа у него такая. Некоторые коллеги даже называют его Дональдом Трампом от ИИ, Ник Бостром обижается, но быстро прощает. Суровый мир научных дискуссий. Конец автобиографического отступления.

II. Что думают специалисты?

Уже сейчас ИИ обладает «ограниченной рациональностью» — может выбирать оптимальные стратегии для достижения результатов. Что будет, если он научится изменять их и менять иерархии своих целей?

В качестве основного аргумента в поддержку своих опасений Бостром приводит стремление к оптимизации. Если сверхинтеллекту нужно будет решить теорему Римана и для этого ему нужно будет превратить половину живых существ в вычислительные машины, то он это сделает не колеблясь, утверждает Бостром. Если сверхинтеллекту нужно будет вылечить рак, то он это сделает, даже если для этого понадобится уничтожить всех людей не больных раком. Автор ставит проблему контроля сверхинтеллекта на первое место в разработке ИИ. Среди ученых такой сценарий получил название парадигмы Бострома в 2000-х. А последние успехи в машинном обучении привлекли внимание к этому вопросу даже техно-олигархов и бизнесменов, которые забили тревогу и откровенно высказывают опасения по поводу развития ИИ.

Рамез Наам сомневается, что мнения Б.Гейтса, И.Маска («сверхинтеллект это новая атомная бомба»), С.Хокинга о рисках ИИ имеют какой-либо вес. «#cпервадобейся. Ни один из них не работал в этой сфере.» Он приводит мнения видных специалистов по ИИ/машинному обучению:

- Майкл Литман, профессор университета Браун и бывший сотрудник Ассоциации ИИ: «Такие страхи просто нереалистичны. ИИ не может просто так взять, проснуться и устроить апокалипсис.»

- Ян ЛеКун, специалист по нейронным сетям в Фейсбуке*: «Некоторые люди считают, что ИИ однажды сможет программировать сам себя. Обычно такие предположения высказывают не специалисты.»

- Эндрю Ын, специалист по машинному обучению в Курсера/Гугл/Байду: «Да, компьютеры становятся умнее. Но это только ум, а не разум и самосознание, и большинство специалистов не считают, что таким способом можно создать сознательный ИИ. Волноваться об опасностях сверхинтеллекта все равно, что переживать из-за перенаселения Марса.»

- Другие, не менее серьезные специалисты считают иначе:

- Ричард Саттон, профессор компьютерных наук в университете Альберта, в своей речи на конференции по безопасному ИИ сказал, что: «существует определенная вероятность появления ИИ уровня человека» и тогда «мы будем вынуждены сотрудничать с ним», а «из разумного раба ИИ может стать разумным соперником.»

- Юрген Шмидхубер, профессор ИИ в университете Лугано и бывший профессор когнитивистики роботов в университете Мюнхена, утверждает, что: «если темпы развития науки сохранятся на уровне прежних, то в ближайшие десятилетия можно ожидать настоящий прорыв в применении ИИ.» На реддите он заметил, что: «На первый взгляд, рекурсивное самоулучшение в машинах Гёделя может помочь в развитии сверхинтеллекта. Гёдель-машины могут отбирать и производить те изменения в своем коде, которые принесут вероятно положительный результат согласно первоначальному набору возможностей. Т.е. мы можем задать начальные «правильные» параметры и машина будет развивать их сама. Другие исследователи могут задать своим машинам иной набор параметров. И начнется машинная гонка эволюций.Невозможно предсказать кто победит в этой гонке и что это принесет нам. Больше об этом.»

- Мюррей Шенехэн, профессор компьютерных наук в Кембридже, в своей книге «Технологическая сингулярность» пишет, что: «От создания ИИ уровня человека (теоретически возможная, но очень сложная задача) до создания сверхинтеллекта может пройти совсем немного времени и этот прорыв можно сравнить с точкой сингулярности, где события будут развиваться быстрее, чем мы предполагаем. Сверхинтеллект превосходящий человеческие возможности будет связан с повышенными экзистенциальными рисками и повышенными выгодами.»

Читайте также: Deep Learning и будущее поискового маркетинга

Не нуждающийся в представлении Алан Тьюринг в работе «Способна ли цифровая машина мыслить?» пишет: «Предположим, что нам удастся создать мыслящие машины. Это произведет резонанс и встретит сопротивление со стороны интеллектуалов и ученых, которые будут волноваться за свое положение и работу. И не зря. Потому, что при достижении машинами человеческого уровня мышления, людям придется очень постараться, чтобы не отстать от машин в разумной деятельности. Также представляется вполне вероятным способность разумной машины создавать свое подобие или еще более разумную машину. Таким, образом, можно ожидать, что однажды разумные машину могут взять под контроль разумное человечество.»

III. Почему искусственный интеллект?

Потому что человеческий мозг это самый близкий аналог того, что происходит в машинном обучении: информационные системы, которые подвергаются машинному обучению называются нейронные сети, состоят из отдельных слоев, каждый из которых отвечает за обработку определенной информации. Если слои нижних уровней могут принимать информацию, то слои верхних уровней способны ее обрабатывать, передавать и использовать для собственной тренировки. Очень похоже на самообучающуюся машину в человеческой голове.

Нейронные сети уже способны различать человеческую речь и лица лучше человека. Это не так безобидно, как кажется на первый взгляд. Нас удивляет победа компьютера над человеком в шахматах или го, хотя у человека нет специальных участков коры головного мозга для решения шахматных задач. Но распознавание и категоризация лиц это уже особая зона коры, которая развивалась эволюционно, и отвечает за выживание. И в этой области ИИ лучше человека уже сегодня.

Так, ИИ способен абстрактно и категорично осмысливать учебную информацию: различать изображения белых собак, черных собак, спаниелей, такс, щенков, взрослых собак и относить все это к классу «собаки.» ИИ может создавать и маркировать порнографические мотивы в изображениях. (Осторожно: настоящая цифровая порнография с точки зрения ИИ). Эти возможности ИИ (категоризация/генерализация/классификация) говорят о простейшей разумной деятельности информационной системы.

Что дальше?

Читайте также: Боты с того света: как нейросети сделают тебя бессмертным

IV. Сравните два подхода:

1. Механистический: классификация/категоризация это безусловно один из признаков разумного агента. Но только один из. Это полезный и замечательный признак, но не основной. Для настоящего интеллекта требуется нечто большее, чем умение щелкать задачки — желание эти задачки щелкать. Различать изображения собак и называть это собакой это круто, спору нет. Настоящему ИИ должно быть присуще в первую очередь желание, мотивационный драйв решать задачи и доказывать теоремы. И создание разумной желающей информационной системы это нечто большее, чем умение сверхбыстро и эффективно решать даже очень сложные задачи по указке инженера этой системы. А желания умной желающей машины могут отличаться от целей человека-творца. Этот подход симпатичен Нику Бострому.

2. Биологический (осторожно: грубое упрощение): большая часть головного мозга состоит из одних и тех же или слегка различающихся клеток, которые развились в ходе эволюции. Если мы сможем понять, как работает один участок мозг, то понять как работают другие участки будет намного проще. Мотивационные процессы человеческой разумной деятельности проходят в тех же или близких участках коры головного мозга что и восприятие/категоризация/классификация информации. Если ученые считают, что информационные системы для восприятия-категоризации-классификации можно воспроизвести на примере человеческого мозга, то для воспроизведения мотивационных разумных систем ученым будет достаточно немного изменить имеющиеся образцы нейросетей для категоризации/классификации. Такие системы не будут похожи на тотально мотивированные и сфокусированные на цели прототипы (человеческий мозг тоже мало походит на такие системы). Скорее всего получится куча мала из разносторонних перцепций, желаний и мотиваций, как это обычно случается в человеческих головах. Такой подход подвергает сомнению тотальную власть человека-создателя над ИИ, ведь запрограммированные мотивы/цели у машины могут не возникнуть или будут значительно изменены.

Биологическое отступление. Эволюционную историю биологического подхода трудно проследить и подтвердить с большой точностью. Разделение между когнитивными центрами восприятия/обработки сенсорной информации (префронтальный кортекс) и центрами памяти/эмоций/поведения (гипоталамус и гиппокампы) произошло на ранних этапах развития позвоночных или еще раньше. Тем не менее, эти разные системы сохранили связи и вмешиваются в функционал друг друга. Одни части кортекса завязаны на гипоталамус и принадлежат лимбической системе. Другие части таламуса (мозга ящерицы, лимбической системы) участвуют в обработке информации (colliculi).

Складывается впечатление, что участки мозга, ответственные за сенсорное восприятие и мотивационно-эмоциональные зоны присутствуют в разных частях коры. Более того, префронтальный кортекс, который считается колыбелью человеческой личности (высшая когнитивная деятельность, оценки, планирование и т.д.), вероятно развился из кортекса первых рыб, из единственного мозга этих рыб. Который, в свою очередь, произошел из тех нескольких сотен нейронов, которые отвечали за восприятие и обработку сенсорной информации у первых червей. Конец биологического отступления.

Ни анатомия, ни эволюция не предполагают сугубо автономного разделения между восприятием, обработкой и мотивацией разумной деятельности. Одни и те же системы могут воспринимать информацию в одном месте, и, с небольшими изменениями, обрабатывать ее и мотивировать дальнейшую деятельность уже в других участках мозга. Все одно. Рискуя погрузиться в метафизику и мистику, скажем только что когнитивные искажения (обработка информации) и визуальные иллюзии (перцепции) имеют больше общего, чем считалось ранее (еще одно упрощение: эти искажения происходят в технически идентичных областях, полях Бродмана).

Читайте также: Новая реальность в поиске: JSON-LD, Mobile-First, «Палех»

V. О происхождении видов

Категоризация / классификация это основа обучения морали. Возможно это и есть мораль. Возьмем к примеру ментальные категории: все знают, что такое птица, но с точным определением «птицы» немного сложнее (аист это птица, пингвин это странная птица, археоптерикс… полу-птица?).

Все помнят, как возникают эти категории. Немного обучения, мать показывает ребенку на курицу и говорит «птица», через пару лет ребенок узнает, что летучая мышь это «не птица» и вот ваш мозг свободно оперирует категориями/классами и сложными абстракциями, а через еще через пару тысяч лет приходит Дарвин и говорит, что есть такой класс позвоночных «птицы», что очень хорошо, но вы и без него это знали.

Люди обучаются этике и морали похожим образом. Когда мы кусаем кого-то, мать/отец/учитель/раввин/священник/шаман говорят нам, что это «плохо», когда мы делимся пирожным, нам говорят, что это «хорошо». На основе работы с такими примерами информационная система оперирует категориями и классами даже если не может дать точные определения этих категорий и классов.

Искусственный интеллект может выработать свою искусственную мораль на основе тех данных, которые ему предоставляют ученые. Мораль возникает во время тренировки ИИ на обучающей информации. Бостром же считает, что мораль / этика ИИ это отдельный модуль или массив обучающей информации.

Обычный бостромовский контраргумент — вероятность того, что ИИ сделает неверные выводы из тренировочной информации и выработает опасную для людей систему ценностей. Например, ИИ может решить, что все вещи, которые делают человека счастливым — хороши. И начнет оптимизировать по максимуму — станет делать человеку инъекции героина все время, чтобы человек оставался счастливым.

Не знаю почему, но человеческая оценка поступков не работает так прямолинейно, и в редких случаях доводит какую-то идею до критической массы. Может это из-за особенностей классификации/категоризации или в конечном решении участвуют посторонние факторы, а не только дихотомия хорошо-плохо. Это может стать интересным заданием для разработчиков ИИ — определить, что именно заставляет информационные системы классифицировать информацию подобно человеку*.

Вообще сложно представить, что у человека есть конкретный моральный ген, моральный участок коры головного мозга, какое-то моральное приспособление. И вряд ли этика и мораль это биологические, эволюционные конструкты, нейробиологические механизмы — скорее всего этика и мораль это необходимые условия просоциального поведения. Этика похожа на крышу дома, которая естественно вырастает вследствии правильной работы низших отделов, обучать искусственный интеллект этике и морали невозможно в отрыве от обычного научения (если мы говорим об ИИ на основе нейронных сетей, которые повторяют структуры головного мозга).

Мотивационная сфера человека работает на дофаминах и системе вознаграждения. Остается надеяться, что близкую человеческой способность классификации можно реализовать в моделях ИИ. Люди могут желать секса без стремления оплодотворять все живое и неживое пока планета не взорвется. ИИ на основе человеческой модели восприятия и классификации данных, будет хотеть решать задачи без маниакального желания подчинить все остальные цели этому желанию. Далеко не всегда и не все люди являются бездумными оптимизаторами: людям свойственно иерархическое целеполагание, все понимают, что быть моральным выгодно в долгосрочной перспективе. Значит и сверхинтеллект, вероятнее всего, не станет роковым для человечества оптимизатором-терминатором.

Самое распространенное предположение (которое поддерживает Ник Бостром): искусственный интеллект будет воплощением чистой логики, напрочь лишенным подобия эмоций/сомнений/колебаний, а нам придется сдерживать этого математического голема**. Если вспомнить такие примеры из человеческой выборки, то эти опасения становятся немного преувеличенными — большинство людей, у которых снижена эмпатия, у которых плохо с этикой и моралью, демонстрируют асоциальное поведение, им сложно обучаться, адаптироваться, просто потому, что им сложно понимать других людей (аутисты, люди с шизоидными расстройствами), даже если они могут извлекать корни из пятизначных чисел. Таким людям тяжело не то, что спланировать убийство комара, они с трудом переносят ощущения новой обуви на своих ногах, о каком захвате мира тогда говорить? Здесь уже явная связь с процессами ментализации, что говорит о неотделимости интеллекта от этики. Мне кажется, что другой сценарий, где ИИ будет мыслить не одними математическими формулами/программным кодом, тоже возможен. Это будет намного сложнее и не так страшно, как предполагает Бостром. И тогда людям понадобятся другие стратегии для сосуществования с ИИ.

*С 4 марта 2016 года действует программа Института Машинного Обучения MIRI «value alignment for advanced machine learning systems» (целеполагание для сложных систем машинного обучения). Задачей этой программы есть создание «инфра-человеческого ИИ», информационных систем с ограниченной автономностью.

**Формальная логика, специалистом по которой является Ник Бостром, не всегда адекватно описывает реальность (или не стремится). Так что эти опасения немного преувеличены и логико-математический терминатор может оказаться не таким опасным, как видится Бострому.

Об авторе рецензируемой книги: шведский философ Ник Бостром, автор более 200 публикаций по глобальным рискам, консеквенциализму, антропному принципу, научной этике. Директор Института будущего человечества, профессор Оксфордского университета. Обладатель ученых степеней по математической логике, физике, вычислительной нейробиологии, философии.

Оригинал: Bostromian paradigm and recent AI progress

*Facebook принадлежат Meta, которая признана экстремистской организацией и запрещена на территории РФ